当前,计算全息三维显示面临的核心问题是如何高速高质量地生成数字化的二维全息图。清华大学曹良才教授课题组提出一种基于模型驱动深度学习的神经网络框架——4K-DMDNet,突破了高质量全息图的高速计算技术,无需迁移学习即可获得高保真的4K全息图,重建质量优于GS迭代算法和数据驱动深度学习算法。

导 读

从阿凡达IMAX 3D席卷全球电影市场,到初音未来三维演唱会火爆动漫圈,再到AR/VR三维头戴显示引领元宇宙发展热潮,三维显示的每次进步都会引爆消费市场,带来极大的社会关注和经济效益。

为了获得更逼真的视觉体验,主流的三维显示商用方案大多基于双目视觉原理设计。

有别于观察真实三维物体,使用双目视觉设备时,观看者眼睛的对焦点始终位于显示屏幕上,而眼睛的汇聚点又时常位于出屏或入屏的三维显示图像上,导致对焦点和汇聚点的不匹配。这种不匹配的现象称为辐辏调节矛盾,易使观看者产生眩晕、疲劳等不良视觉反应,一定程度上限制了产品的用户体验。

计算全息三维显示系统可从原理上避免辐辏调节矛盾,具有光路简单、结构紧凑等突出优势,受到了学界和产业界的重点关注,被认为是三维显示的未来形态。

原理上来说,计算全息三维显示技术利用衍射光学计算,将待显示三维目标的光场信息编码在数字化的二维全息图中,进而利用平面波照射上载有该二维全息图的空间光调制器,最终实现任意距离上的三维目标光学重建,因此在头戴显示、抬头显示和投影显示等众多三维显示应用领域都具有较大的应用潜力。

当前,计算全息三维显示面临的核心问题是如何高速高质量地生成数字化的二维全息图。

近日,清华大学曹良才教授课题组提出一种基于模型驱动深度学习的神经网络框架,突破了高质量全息图的高速计算技术,实现了高保真彩色4K全息三维显示。该神经网络框架被称作4K-DMDNet。

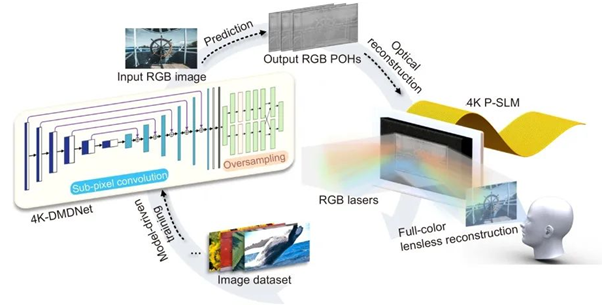

图1 基于4K-DMDNet的全息图编码计算及光学重建过程示意图

由于空间光调制器的限制,当前全息面上的复振幅分布通常会被简化为纯振幅或纯相位分布。其中,纯相位型全息图的生成过程为典型的不适定逆问题,具有解可能不唯一、不稳定或不存在的问题。

迭代算法可以将纯相位型全息图的计算问题转化为最优化问题求解,可以得到收敛性较好的数值解,但需要在计算速度和重建质量间进行权衡。

深度学习强大的并行处理能力,为求取最优解问题带来了革命性的思路变化,对计算全息领域产生了深远影响。

深度学习事先获取三维目标训练集和对应的全息图集,用以分别充当神经网络的输入输出项,进而通过训练学习二者间的映射关系,最终可以基于训练集外的输入项,快速预测出相应的输出项,有望同时兼顾全息计算中的计算速度和重建质量。

基于神经网络的计算全息技术发源于1998年,但受限于当时计算机的软硬件性能,只得到了小尺寸和低质量的初步结果。

随着GPU和卷积神经网络的广泛应用,当前软硬件性能更加符合计算全息技术的数理特点,基于深度学习的计算全息技术也迎来了高速的发展。

2021年,麻省理工学院计算机与人工智能实验室的研究人员在Nature发表论文,提出的Tensor holography网络在智能手机上即可实现2K全息图的实时生成。

目前,为了获得精确的网络预测结果,训练集和相应全息图集的数据量往往十分庞大,其中全息图集的生成过程又较为耗时。且由于网络只是单纯学习输入输出间的映射关系,所以全息图集的质量往往限制了网络训练结果的上限。

为突破上述数据驱动深度学习网络的性能瓶颈,基于模型驱动的深度学习网络应运而生。

这类网络采用逆问题相对应的正向物理模型充当约束条件,可以在无需全息图集的情况下自主地学习全息图的编码方式,一定程度上突破了全息图集规模和质量对全息计算的限制。

然而,受限于当前网络的泛化能力,传统模型驱动的深度学习网络常需针对显示目标进行单独的迁移学习以获得更优质的效果,所需的额外时间成本限制了模型驱动深度学习的实际应用。

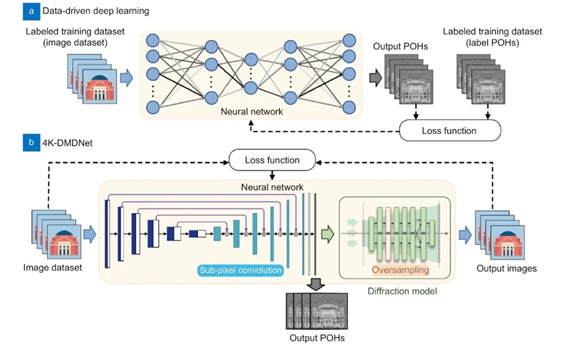

图2 (a)数据驱动深度学习与(b)4K-DMDNet的原理对比

文章提出的4K-DMDNet模型驱动深度学习网络使用了U-Net型残差神经网络框架,并加入了菲涅尔衍射模型作为网络训练的约束条件,无需迁移学习即可获得高保真的4K全息图。

通常来说,深度学习网络预测结果的质量受到网络学习能力有限和训练过程约束条件不足两方面的限制。

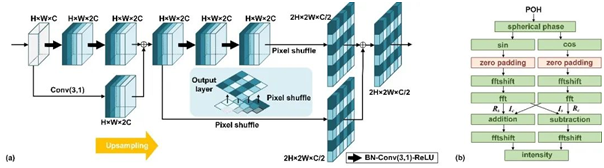

针对网络学习能力有限的问题,4K-DMDNet引入亚像素卷积策略。在上采样支路中首先通过卷积将通道数扩大4倍,再进行像素洗牌得到空间信息,解决了传统转置卷积中为还原图像尺寸而添加大量零参数的问题。在不改变整体数据量的情况下,将网络上采样支路的可学习参数提升至原来的4倍,有效增强了网络的学习能力,使重建图像的清晰度和保真度有了明显的提升。

针对训练过程约束条件不足的挑战,4K-DMDNet在菲涅尔衍射模型中引入密集采样操作。模型中的频域约束范围被补零扩展至原图像的二倍,基于空域与频域间的采样对应关系,使得重建图像满足了奈奎斯特采样定理的要求。该操作在收紧频域约束条件的同时,增强了衍射模型的准确性,获得了更准确的光学重建结果。

图3 (a)基于亚像素卷积原理的网络上采样模块,(b)衍射模型加密采样在网络中的实现

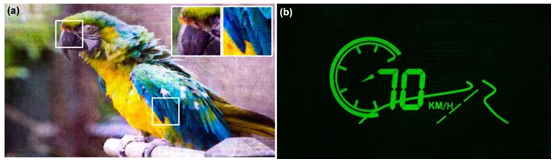

论文利用二值及彩色图像对4K-DMDNet进行了光学实验的验证。实验结果表明,4K-DMDNet可实现4K场景的高保真全息重建,重建质量优于GS迭代算法和数据驱动深度学习算法。

图4 不同类型图像的光学重建结果:(a)彩色图像,(b)二值图像

研究团队简介

曹良才,清华大学精密仪器系教授、博士生导师。国际光学工程学会SPIE和美国光学学会OPTICA会士,教育部长江学者特聘教授。2005年获得清华大学光学工程专业博士学位,毕业后留校工作至今,加州大学圣塔克鲁兹分校和麻省理工学院访问学者,研究方向主要为全息光学成像与显示技术。

课题组主页:http://www.holoddd.com

相关论文

Liu KX, Wu JC, He ZH, Cao LC. 4K-DMDNet: diffraction model-driven network for 4K computer-generated holography. Opto-Electron Adv 6, 220135 (2023).

微信